知覚問題:人工内耳はどこまで進化するのだろう。

スマートスピーカ

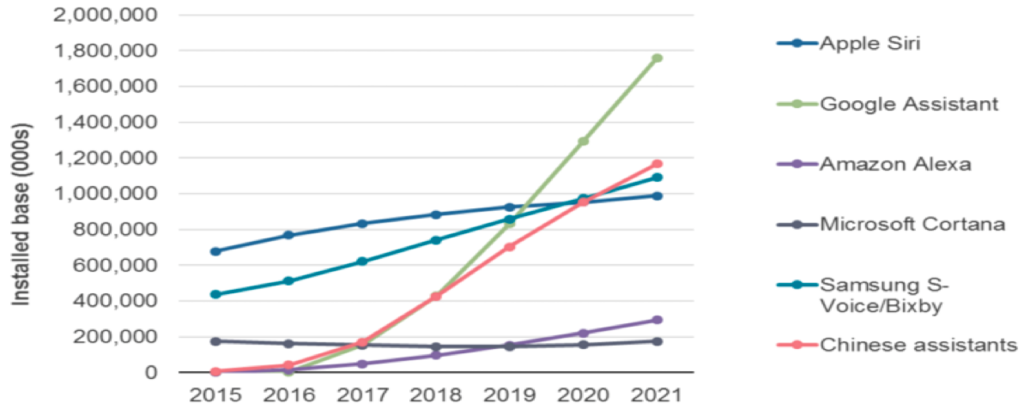

AmazonのEchoやGoogle Assistantを始め各社がスマートスピーカのシェア争いに依存でいる。先行している米国では、すでに前年比2.3倍の3560万人が利用し、そのうち70%がAmazon Echoを占めているという(参考1)。一方、スマホやタブレットに実装されているAI音声アシスタントはすでに35億台を超えていて、2021年には75億台を超えるという。こちらの分野ではGoogle Assistantの伸びが突出する見込みだ。

(出典:ロボスタ、参考1)

聴覚と視覚

今までのSNSはスマホやタブレットでのテキストや写真や映像といった視覚情報ベースだった。最初はテキストベースだったが、写真ベースになり、現在は動画ベースのSNSが急速に普及している。携帯電話は、外で本来話をするツールだったはずだが、ある男子高校のアンケートで不要な機能の一番が通話になるなど、すでに通話用のツールの枠を超えている。しかし、一方で、音声認識機能の進化は目覚ましく、テキストを入力するより、音声認識モードにして、スマホに向かって話をする方が早いし、楽になってきた。スマートスピーカは今後どこまで進化するのだろうか。

生物の進化の過程での聴覚と視覚

1) ナマズの耳

魚の耳に相当する器官は側線だが、ナマズの場合にはそれが横に並んだ大孔器だ。そして、ナマズはこの器官のために水圧や水流の変化を感じ取る能力が高い。ナマズは地震を検知するという都市伝説があるが、これも根拠のあるものかもしれない。

(出典:FIMO、参考2)

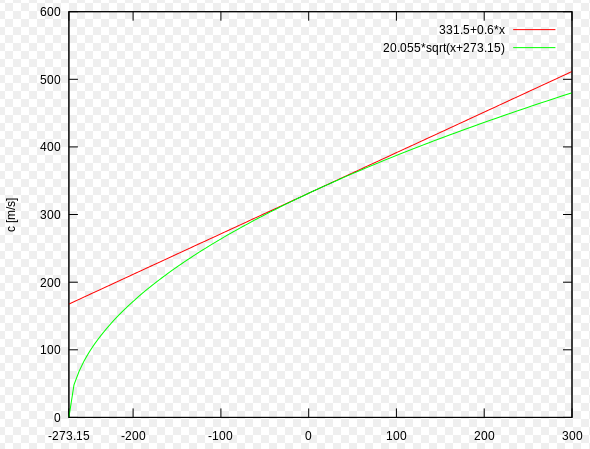

2) 水中での音速

音の速度は真空であれば秒速330mとよく言われるが、厳密に言うと気圧や気温に依存する。高温になると分子の活動が活発になるので音速も早くなる。また、分子量が小さい物質ほど音速が早くなる。ヘリウムガスを吸って話をするとドナルドダックのような声になるのは、音速が3倍近く速くなって、甲高い声になるためだ。水中だと真空の約5倍(秒速1500m)となる。氷だとさらに倍の秒速3230mだ。

(出典:Wiki、参考3)

3) 海中は沈黙の世界か?

中学生の頃に好きだった女の子から本をプレゼントしてもらった。「沈黙の世界」という本で、海洋学者であるジャック・クストーが美しい海洋を紹介してくれた。その奥深さに単純な自分は感動し、ダイバーを目指した。成人後、ダイビングライセンスを取って海中に潜ると確かにそこは沈黙の世界だ。でも、そこで生きる生物は、視覚よりも聴覚や触覚の方がより研ぎ澄まされたのではないだろうか。

4) 動物の可聴周波数帯域

人間が感じることのできる音は20Hzから2万Hz程度と言われている。一方、動物が聞こえる周波数は犬が65Hzから5万Hz、猫が60Hzから6.5万Hz、イルカが150Hzから15万Hz、コウモリが3000Hzから12万Hzだという。しかし、魚は50Hzから5,000Hzと極端に狭い。やはりこれは水中では高い音はすぐに減衰するからなのだろうか。

(出典:パイオニアのホームページ、参考4)

5) 水中の減衰量は周波数が高いほど大きい

下の図は周波数と音波の減衰の特性図だ。周波数が10倍になるとレベルが20dB下がるので、つまり100分の一になっている。つまり、損失量は周波数の二乗に比例して増大する。これは電波の場合と同じ仕組みなのだろう。

(出典:株式会社アクアサウンドのホームページ、参考5)

6) イルカのエコーロケーション

イルカの場合には、超音波を出すことで獲物となる魚の位置関係を確認したり、強い超音波で麻痺させたりする。超音波に慣れていない魚はびっくりして気絶しちゃうのかもしれない。どうやってイルカはこんな能力を身につけたのだろうか。不思議だ。

(出典:まとめサイト、参考6)

7) 人間の耳の構造

人間の場合には、どのようにして音を聞くのだろうか。下の図にあるように外耳と中耳と内耳の3つに分かれている。外耳は空気の世界で外からの音を効率的な集めて、鼓膜に伝える役割を持っている。内耳は液体の世界で音を感じる役割を持っている。そして中耳はこの外耳と内耳を結ぶ役割だ。人間の中耳は、3つの耳小骨で構成されている。つまり、外耳(鼓膜)とつながるツチ骨と、内耳(前庭)につながるアブミ骨と、それらを結ぶキヌタ骨だ。そして、中耳は顎につながっているので、例えば海中にダイビングするときに水圧調整がうまくいかないと耳が痛くなるが、顎を動かしたりすると治ることがあるのもこのような構造のせいだ。

(出典:看護Room、参考7)

8) 音の振動を感じる構造

鼓膜の信号は中耳を介して、内耳の卵円窓から前庭階を通して蝸牛をぐるっと回って、正円窓から出て行く。その途中には蝸牛神経が弦のように張り巡らさらていて特定の音と共鳴することで音を感じるという仕組みだ。小中学校の理科でここまで説明してくれたらちゃんと理解していたかもしれない(笑)。しかし、直感と異なるのは、蝸牛の根本が高い音で、蝸牛の細い部分が低い音に共鳴するという。逆だと思っていた。

(出典:聴覚の経路、参考8)

9) 突発性難聴

突発性難聴になったのは何年前だろう。音楽を聴きながらゴルフの練習をしていたら音が急におかしくなり、イヤホンを片方ずつ聞いたら左耳が聞こえていない。急いで帰宅するが、途中でトラックが通過する音がジェット機が通るような音に聞こえた。すぐに病院に行くが、突発性難聴は治らないもの。悪化しないように治療しましょうと低い志で治療が開始された。結局、悪化はしなかったが、完治もしなかった。でも、電話で通話するときに使う周波数帯域(300Hzから3400Hz)は全く問題なく、4000Hzを超えたあたりからダメだ。今でも、小さな子供の高い声は左耳では聞き取れない(涙)。しかし、悔しいのは、突発性難聴の原因以前に、外耳が悪いのか、中耳が悪いのか、内耳が悪いのかわからないことだ。個人的にはデジタル方式の時代に運転しながら何時間も携帯電話で通話し続けた時に、頭がクラクラとした経験がある。あれが左耳だったので、それが原因かもしれないと推測している。でも、どうして、それで突発性難聴になるのかの理屈が全く分からないし、医者も説明してくれない。頭のMRI(磁気共鳴画像)を念のため撮影してもらうことになり、その結果を聞くと年齢どおりの劣化具合ですね、とのこと。加齢が原因と言われても、そんな説明では納得できない。

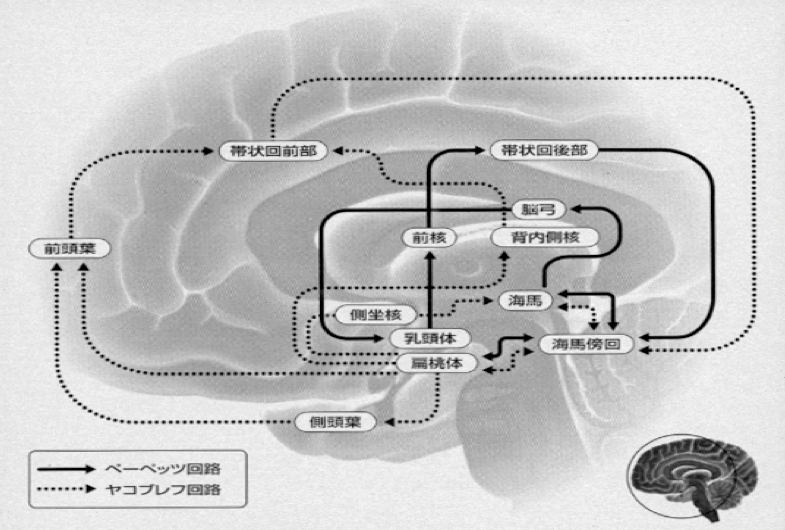

10) ペーペッツ回路とヤコブレフ回路

だんだん難しくなってきた。ここら辺で止めるが、聴覚や視覚と言った信号は脳で処理されるが、その回路として2つある。一つはペーペッツ回路で記憶系を担当する。他方はヤコブレフ回路で情動系の回路だ。2つの回路はお互いに交流して、影響しあっている。

(出典:脳と精神、参考9)

人工内耳の可能性

医療の現場では、人工内耳の開発が進んでいる。下の図は体内装置と対外装置を組み合わせて使う人工内耳の例だ。補聴器のように音量を上げるのではなく、音を聴覚神経に直接伝える方法だ。海外では生まれつきの聴覚障害者に対する治療として活用されている。例えば、スウェーデンでは新たに生まれるろう児の90%は人工内耳の手術を受けている。日本でも片耳であれば保険適用が可能と言う。

(出典:CNETジャパン 、参考10)

人工内耳の適用状況

最近のデータではないが、1998年時点で世界で1.8万人が使用し、うち日本人は866人だ。使用数では5番目だが、若者への適用は少なく、18歳未満への適用ではかろうじてイタリアよりも多い9番目だ。若いときに手術する方が効果が高いとも言われている。日本では適応年齢は2006年までは2歳以上から1歳6ケ月に、そして2014年からは原則1歳以上(体重8kg以上)と人工内耳適応基準が改定された。2015年時点の論文(参考13)では人工内耳の世界での利用は約25万人、うち日本では1万人で世界4位だという。

(出典:音声言語医学委員会報告、参考11)

人工内耳の小型化・軽量化

機器の小型化は着実に進んでいる。しかし、体内装置の小型や低消費電力化など技術的な問題は多い。最近では、機器の細かな操作はスマホのアプリで行うようになっているのが多い。

(出典:参考12)

まとめ

スマートスピーカーについて調べるつもりが、聴覚のことを深掘りしてしまった。聴覚と視覚は脳科学的にはそのメカニズムに共通点があり、特に記憶を担当するペーペッツ回路と、情動を担当するヤコブレフ回路が相互に影響しあいながら機能していることがわかってきている。人工知能が進歩した場合に、今後はより脳に近いところでの信号をやりとりする脳間通信も研究されている。テレパシーが実現するのも時間の問題かもしれない。しかし、思ったことや感じたことが脳の外に出すことは究極のプライバシーの侵害にならないのだろうか(笑)

以上

参考1:https://robotstart.info/2017/05/19/virtual-digital-assistants.html

参考2:http://www.fimosw.com/u/zacco/vzxmz5ehssmudo

参考3:https://ja.wikipedia.org/wiki/音速

参考4:http://pioneer.jp/carrozzeria/museum/oto/01_a07.html

参考5:http://aqua-sound.com/business/consulting/noise.html

参考6:https://matome.naver.jp/odai/2140223070880022301

参考7:https://www.kango-roo.com/sn/k/view/1926

参考8:https://blogs.yahoo.co.jp/yuyamichidori/11160610.html

参考9:http://www.actioforma.net/kokikawa/kokikawa/dynamism/dynamism.html

参考10:https://japan.cnet.com/article/35104860/

参考11:https://www.jstage.jst.go.jp/article/jjlp1960/39/4/39_4_488/_pdf

参考12:http://www.cochlear.com/wps/wcm/connect/sg/home/discover/cochlear-implants/nucleus-6/six-reasons/smallest-sound-processor

参考13:https://www.jstage.jst.go.jp/article/jalliedhealthsci/6/1/6_15/_pdf